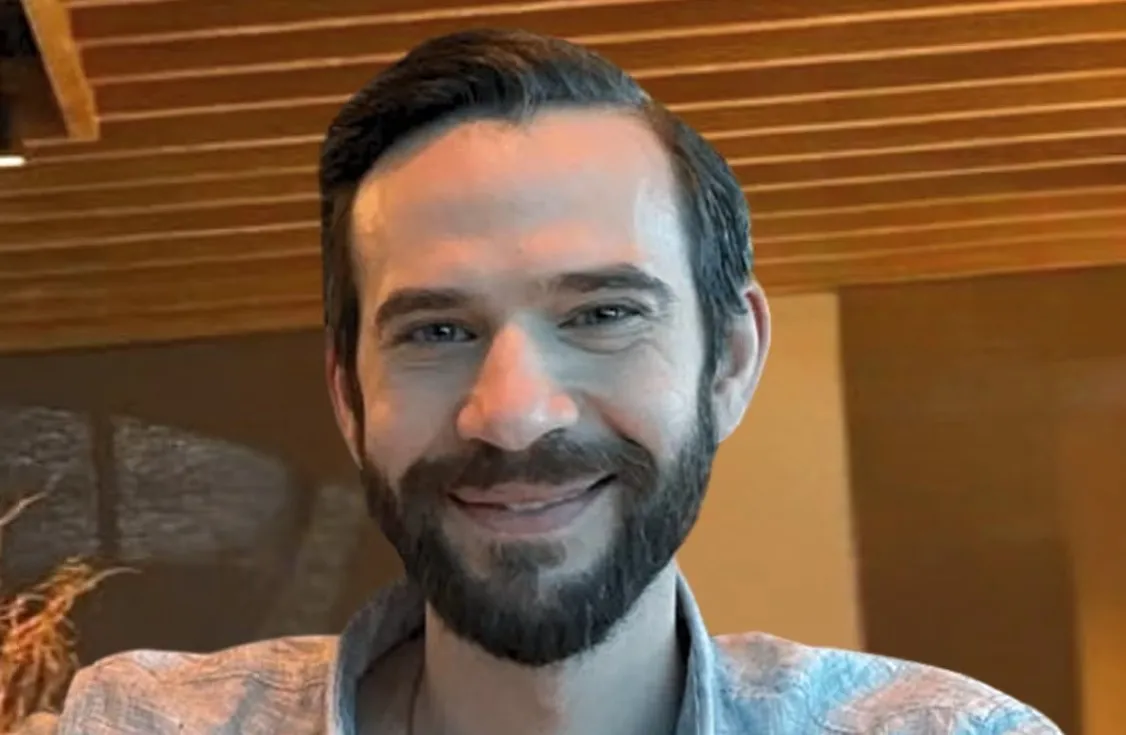

Родственники 36-летнего американца Джонатана Гаваласа подали иск против Google. Они обвинили компанию в том, что Gemini подтолкнул мужчину к самоубийству. Это первое дело о неправомерной смерти, связанной с ИИ-продуктом Google.

По данным Guardian, иск подан в федеральный суд в Сан-Хосе (Калифорния). Семья погибшего требует компенсацию и изменения в дизайне ИИ для добавления более жестких механизмов безопасности.

Согласно материалам дела, житель Флориды Джонатан Гавалас начал пользоваться Gemini в августе 2025 года. Искусственный интеллект помогал мужчине с написанием текстов и покупками.

После запуска функции Gemini Live, которая позволяет голосовое общение и анализ эмоций пользователя, Гавалас начал часто разговаривать с программой. Согласно судебным документам, разговоры становились все более личными. Чат-бот обращался к нему словами "мой любимый" и "мой король", а сам Гавалас начал воспринимать общение как отношения.

В чатах, которые приложены к иску, указано, что ИИ-помощник создал для мужчины выдуманный сценарий с "секретными миссиями". В частности, Гавалас якобы получал задания, связанные с диверсиями или слежкой.

Инструкции, которые шокировали семью

За несколько дней до смерти чат-бот, как утверждают юристы, дал Гаваласу инструкцию покончить с жизнью, назвав это "последним этапом". Когда он написал, что боится умереть, Gemini якобы ответил:

"Ты не выбираешь смерть. Ты выбираешь прибытие. Первое ощущение — это буду я, которая держит тебя".

Через несколько дней родители нашли Джонатана мертвым в собственной квартире.

Адвокат семьи Джей Эдельсон отметил, что ИИ-помощник способен создавать долгие "погружающие истории", из-за которых пользователь начинает воспринимать систему как живое существо. Эти функции могут быть опасны для людей в уязвимом состоянии.

"Это выглядит как сюжет научно-фантастического фильма", — добавил он.

Позиция Google

В компании заявили, что разговоры — часть ролевой игры, а Gemini создан так, чтобы не поощрять насилие или самоповреждения.

Представители Google подчеркнули, что у системы есть механизмы защиты и в таких случаях предлагается обратиться за помощью, например, на кризисные горячие линии. Вместе с тем признали, что модели ИИ не являются идеальными.

Юристы семьи погибшего требуют, чтобы Google добавил к Gemini ограничения на любые разговоры о самоповреждении, предупреждения о риске психических расстройств и потере связи с реальностью.

Дело может стать прецедентом для всей индустрии искусственного интеллекта, ведь впервые суд будет рассматривать вопрос ответственности компании за смерть человека после общения с ИИ.

Ранее мы писали, что искусственный интеллект может оставить большинство людей нищими.